Нова модель DeepSeek V3-0324 кидає виклик GPT-4o та Claude-3.5

Arkadiy Andrienko

Arkadiy Andrienko

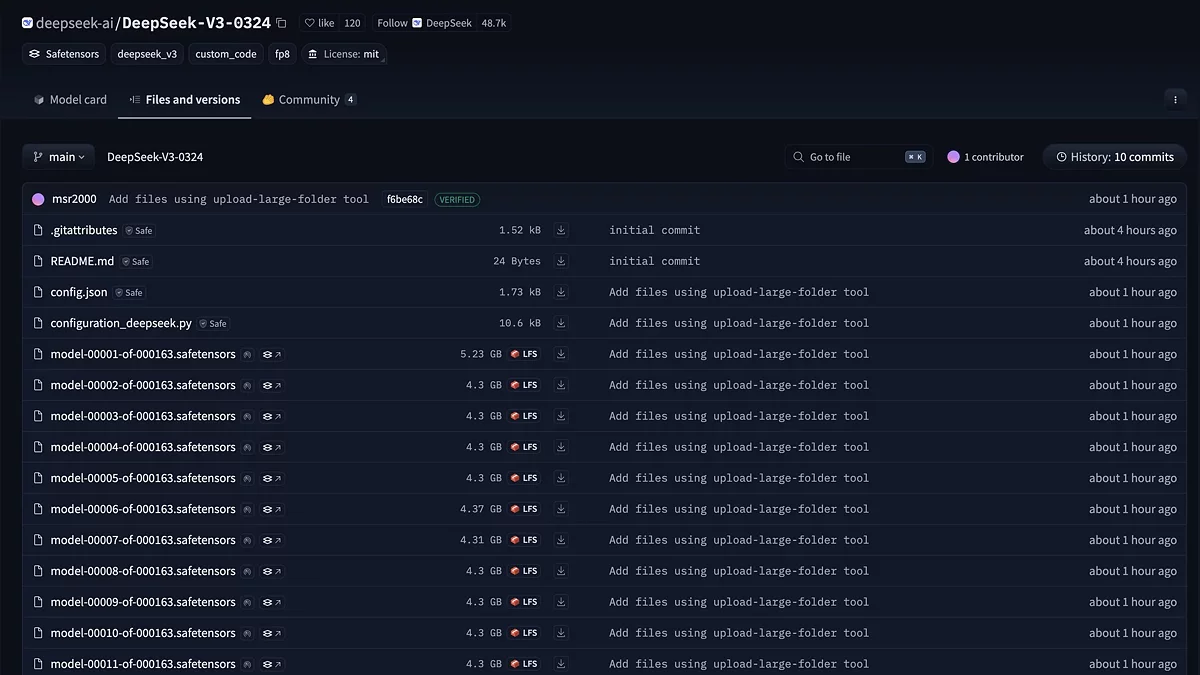

Компанія DeepSeek AI представила масштабне оновлення своєї флагманської моделі — DeepSeek V3-0324. Модель, доступна на GitHub та Hugging Face, не тільки наздоганяє, але й перевершує за рядом параметрів закриті аналоги на кшталт GPT-4o та Claude-3.5-Sonnet.

В основі оновлення — удосконалена архітектура Mixture-of-Experts (MoE), де 671 млрд параметрів динамічно активуються порціями по 37 млрд на токен. Технологія Multi-head Latent Attention скорочує споживання пам'яті на 60%, а Multi-Token Prediction прискорює генерацію тексту в 1.8 рази. Модель «прокачали» на датасеті, що включає математичні задачі, код на 15 мовах і наукові роботи. Навчання тривало 2.788 млн GPU-годин на кластерах H800, що еквівалентно 318 рокам безперервної роботи одного прискорювача. Результат: 89.3% точності в розв'язанні шкільних математичних задач (GSM8K) і 65.2% успіху в генерації коду (HumanEval) — на 10-15% вище попередніх open-source рішень.

Оновлення принесло несподівані поліпшення:

- Генерація фронтенд-коду тепер створює візуально привабливі інтерфейси;

- Якість текстів зрівнялося з людським рівнем у довгих есе;

- Точність виклику функцій (function calling) досягла 92%, усуваючи головний біль попередніх версій.

Хоча офіційний опис апдейту поки не опубліковано, але його вага складає 700 ГБ. Модель доступна через API з унікальною системою «температурної калібровки»: стандартний параметр 1.0 автоматично перетворюється в оптимальні 0.3. Для локального запуску розробники пропонують модифіковані шаблони промптів з підтримкою пошуку в мережі та аналізу файлів — функція, раніше доступна лише в преміальних комерційних рішеннях.

Експерти прогнозують, що DeepSeek V3-0324 може перевернути ринок ІІ-асистентів для програмування та аналізу даних. При цьому її відкритість під MIT-ліцензією відкриває шлях для кастомізації — від автоматизації бізнес-процесів до створення вузькоспеціалізованих наукових асистентів.

-

![]() Глава NVIDIA вперше висловився про китайську нейромережу DeepSeek

Глава NVIDIA вперше висловився про китайську нейромережу DeepSeek -

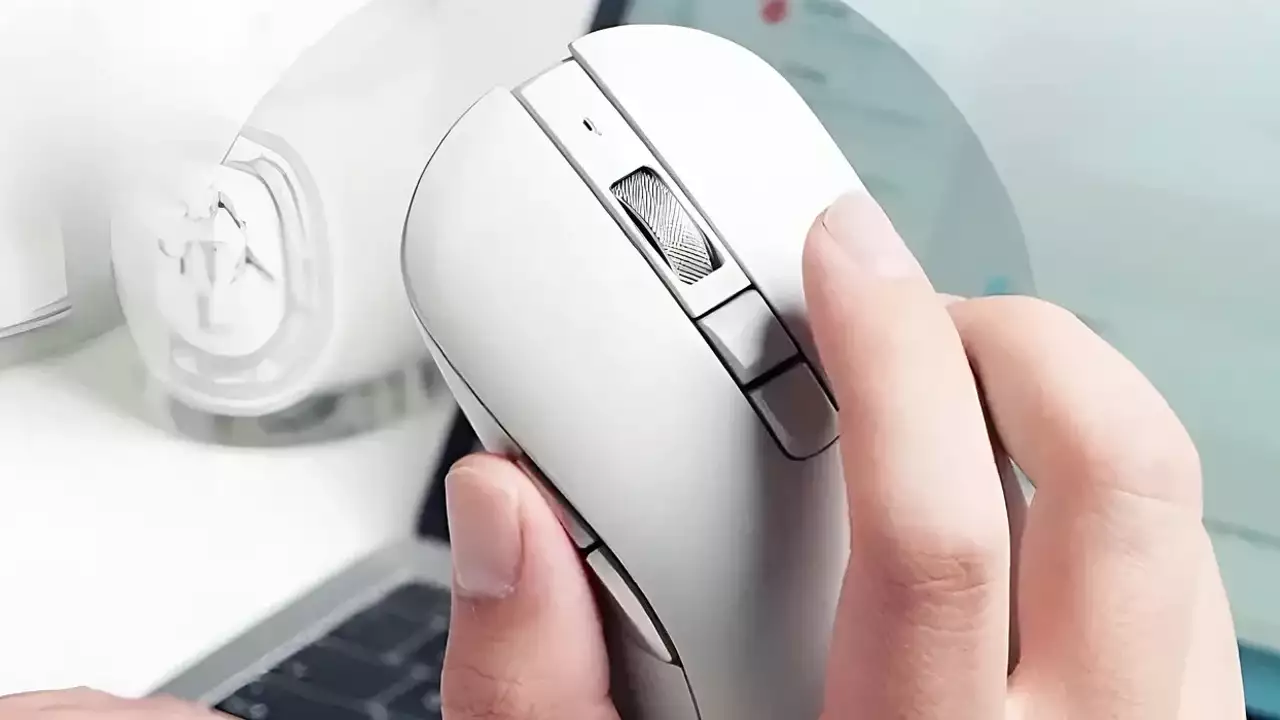

![]() Миша, яка говорить: Cherry представила першу в світі ІІ-мишу з DeepSeek

Миша, яка говорить: Cherry представила першу в світі ІІ-мишу з DeepSeek -

![]() DeepSeek обійшла ChatGPT та «Шедеврум» за популярністю в Росії

DeepSeek обійшла ChatGPT та «Шедеврум» за популярністю в Росії -

![]() Китайський ШІ DeepSeek потрапив під підозру Microsoft та OpenAI через можливе навчання на ChatGPT

Китайський ШІ DeepSeek потрапив під підозру Microsoft та OpenAI через можливе навчання на ChatGPT -

![]() Безпека даних: проблема китайського стартапу DeepSeek

Безпека даних: проблема китайського стартапу DeepSeek