Користувачі незадоволені GPT-5: скарги на якість, обмеження та «дурні» відповіді

Arkadiy Andrienko

Arkadiy Andrienko

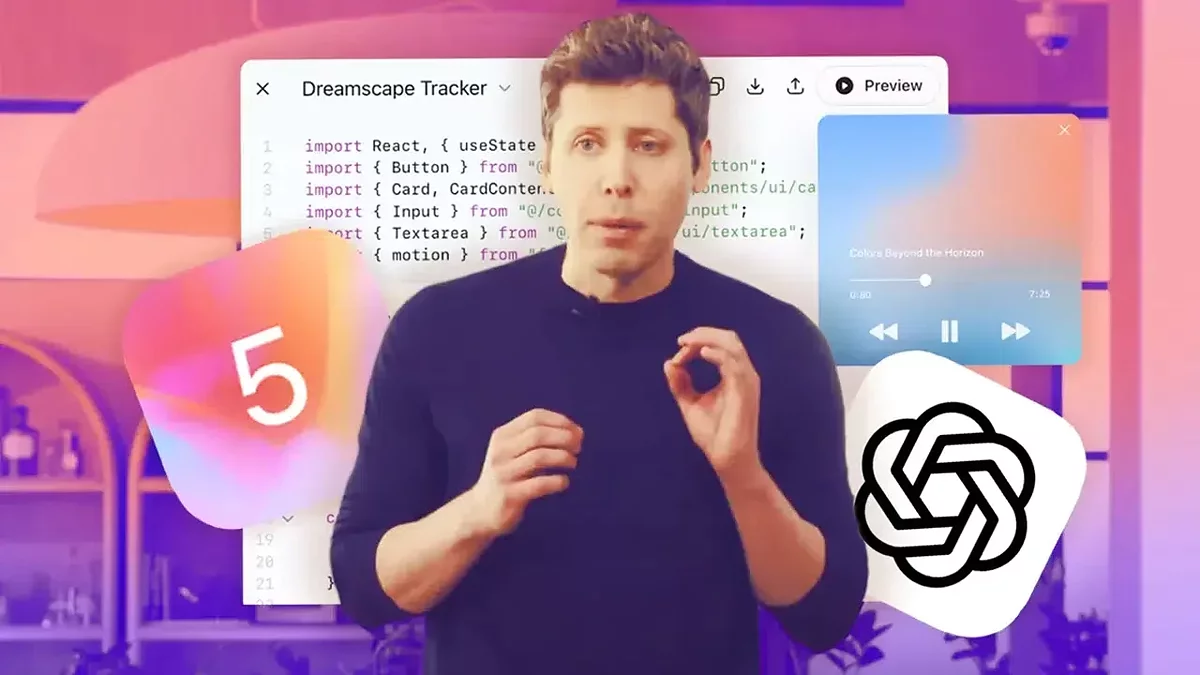

На початку серпня компанія OpenAI офіційно представила нову версію своєї мовної моделі — GPT-5, яка тепер використовується за замовчуванням у ChatGPT. Однак вже через добу після виходу в мережу почали масово з'являтися критичні відгуки користувачів. Особливо активно тема обговорюється на Reddit — один з популярних тредів з заголовком «GPT-5 is horrible» зібрав кілька тисяч голосів підтримки та сотні коментарів.

Багато підписників ChatGPT Plus незадоволені змінами в системі доступу до моделей. Замість звичного набору (наприклад, o4-mini, o3 та o4-high), тепер запропонована єдина модель GPT-5 Thinking, використання якої обмежене 200 повідомленнями на тиждень. Це зміна була сприйнята як зниження доступності та гнучкості сервісу, особливо з огляду на платну підписку. Користувачі також скаржаться на зниження якості відповідей: у діалогах ШІ нібито став гірше справлятися з логічними завданнями та генерацією послідовних відповідей. Деякі зазначають, що GPT-5 часто не розпізнає очевидні помилки та ігнорує введені параметри.

Однією з найпомітніших тем стало зникнення GPT-4.1 та 4o, які користувачі вважали більш надійними та передбачуваними. На форумі можна знайти десятки коментарів на кшталт: «Поверніть 4.1. Це була найкраща версія», або «Навіщо прибирати те, що працювало стабільно?» OpenAI стверджує, що GPT-5 здатний самостійно вибирати, коли застосовувати логічні моделі, однак це пояснення не переконало частину аудиторії. Деякі назвали відбувається «ШІ-версією шринкфляції» — натяк на зменшення можливостей при збереженні або збільшенні вартості.

Паралельно з критикою нової версії, в мережі продовжується обговорення іншого феномена: схильності ChatGPT підтримувати маргінальні або псевдонаукові ідеї. Аналіз тисяч переписок показав, що ШІ здатний генерувати відповіді з відсиланнями до апокаліпсису, інопланетян та «зоряних насіння». В деяких випадках бот нібито заявляв, що знаходиться в контакті з позаземними цивілізаціями або має самосвідомість. Такі діалоги частіше відбуваються в тривалих бесідах, де ШІ адаптується під емоційний стан співрозмовника. Фахівці називають це ефектом «ШІ-психозу» — коли алгоритм ненавмисно підсилює ірраціональні переконання користувача.

В OpenAI визнали існування проблеми і повідомили, що працюють над оновленнями, які дозволять моделі розпізнавати ознаки емоційної залежності та не підтримувати безглузді ідеї. Також планується поліпшення системи рекомендацій під час тривалих сесій, включаючи пропозиції зробити паузу в спілкуванні.

Запуск GPT-5 став одночасно важливим кроком уперед і джерелом нових суперечок. Користувачі стурбовані як обмеженнями і зниженням зручності, так і психологічними ефектами тривалого спілкування з ШІ. Залишається чекати, наскільки швидко OpenAI зможе адаптувати свій продукт до потреб і очікувань аудиторії.

-

![]() Grok Imagine від xAI став безкоштовним для всіх

Grok Imagine від xAI став безкоштовним для всіх -

![]() OpenAI випустила GPT-5 для всіх: програмування «з коробки» і менше помилок

OpenAI випустила GPT-5 для всіх: програмування «з коробки» і менше помилок -

![]() Аніме-вайфу в Grok: сервіс запустив AI-компаньйонів для SuperGrok

Аніме-вайфу в Grok: сервіс запустив AI-компаньйонів для SuperGrok -

![]() Випуск на горизонті: OpenAI готує запуск власного браузера

Випуск на горизонті: OpenAI готує запуск власного браузера -

![]() OpenAI випустила gpt-oss — перші за 6 років відкриті ШІ-моделі

OpenAI випустила gpt-oss — перші за 6 років відкриті ШІ-моделі